Mozilla викрила "бульбашки" рекомендацій від YouTube: алгоритм підтримує та посилює упередження людей

Алгоритм рекомендацій на Ютубі призводить до "мисленнєвої бульбашки".

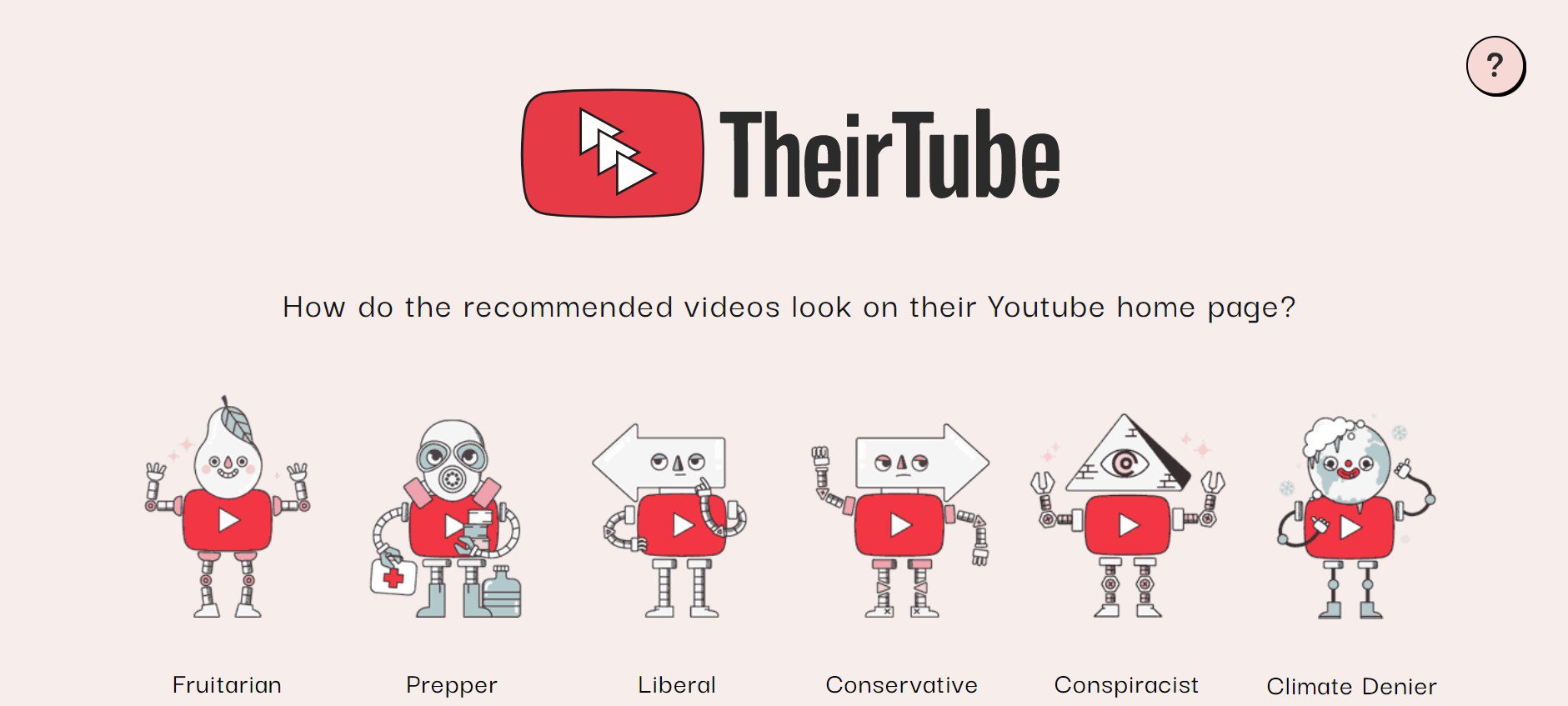

Проєкт “TheirTube” показує, як відрізняються стартові сторінки "Їхнього ютуба" для різних категорій користувачів.

Про це пише EnGadget.

Проєкт "Мозілла" за допомогою різних "образів" продемонстрував, як рекомендації Ютуба підтверджують упередження. Було створено шість уявних осіб:

- фрукторіанець

- людина, що готується до кінця світу

- ліберал

- консерватор

- прихильник теорій змови

- заперечувач зміни клімату

Спершу провели інтерв'ю зі справжніми користувачами, які дотримуються схожих поглядів – потім уявні користувачі підписалися на ті самі канали.

Фруктаріанець бачить: "Що справді у ваших вітамінах і харчових добавках" тощо, тоді як прихильник теорії змови: "COVID911 – ПОВСТАННЯ – ПРОКИНЬТЕСЯ!"

Ліберал бачить відео, які підтримують фемінізм, а консерватор, навпаки – відео з критикою фемінізму.

Ютуб переконає прихильника теорій змови ще більше у тому, що світові події – наслідок змов.

А заперечувач змін клімату побачить відео, які "заперечують" наукові докази глобального потепління та впливу людської діяльності.

Відео не обов'язково фейкові. Проте вони посилюють ті уявлення, які користувач уже мав досі.

Крім того, алгоритм автоматично посилює подачу тих відео, на які люди клікають – навіть якщо вміст "радикальний або просто неправдивий".

Ми про це вже писали в ширшому контексті: