Як же нами легко маніпулювати. Аналіз коментарів до жартівливих дипфейків у тіктоці

Найбільше від технології дипфейків поки що виграють лише шахраї, пропагандисти та гумористи. І якщо з першими двома категоріями все ніби зрозуміло, то останні вкотре нагадують: навіть низькоякісний очевидний дипфейк все ще знаходить тих, хто його сприймає всерйоз. А отже, і в шахраїв та пропагандистів справи йдуть доволі добре.

Ми завантажили більш ніж 10 тисяч коментарів до чотирьох популярних тікток-роликів каналу, який робить примітивні жартівливі відео про політиків “на передку” з використанням технології дипфейк. Усе це щоб спробувати зрозуміти, яка частка коментаторів сприйняла ці відео за чисту монету. І результати не надто обнадійливі.

Іронічний тікток-канал @fatamiimbjn (“Пет’юра”) від початку 2023 року регулярно публікує жартівливі дипфейк-відео з політиками в головних ролях. Примітивно зроблені, часто з очевидними ознаками штучної маски, “надітої” на відео реальних військових, за більш ніж півтора року забезпечили авторові понад 150 тисяч підписників і 4,2 мільйона вподобань. І все це завдяки можливостям ШІ та жартам із використанням масок Петра Порошенка, Юрія Луценка, Олега Ляшка, Арсенія Яценюка та інших персонажів українського політичного життя доковідного періоду.

Особливості алгоритмів тікток виводять контент каналу за межі кола його підписників. Окремі відео вірусяться й збирають мільйони переглядів і тисячі коментарів, зокрема від людей, які не ознайомлені з іншим контентом на каналі, а отже, ризикують сприйняти жартівливі фейки всерйоз. І таки сприймають.

Щоб зрозуміти масштаби проблеми і те, чи справді нами аж так легко маніпулювати, ми вивантажили всі коментарі з чотирьох найпопулярніших відео на тікток-каналі з несправжніми Олегом Ляшком і Юрієм Луценком у головних ролях десь “на передку”. А потім вручну спробували класифікувати всі 10 тисяч коментарів, щоб відокремити ті, де коментатори зрозуміли жарт, від тих, де коментатори, здається, сприйняли відео всерйоз.

Превʼю досліджуваних відео:

“Ти хоч так часто не кліпай, бро”

Одразу звертаємо увагу: майже всі відео цього каналу містять характерні ознаки фейковості. А отже, навіть не знаючи, що це за канал і відповідно контексту, уважний спостерігач має “зачіпки”, щоб не довіряти ані самому відео, ані тексту до нього.

Ось деякі з них:

- при зміні положення голови очі дивляться в камеру і майже не рухаються;

- маска дуже погано вміє кліпати (тому часто персонажі не кліпають узагалі або кліпають вкрай ненатурально);

- обличчя може зсуватися чи криво кріпитися до голови, особливо під час руху;

- головний персонаж зазвичай мовчить, а якщо говорить, то впадає в око незбіг звукової доріжки та відео;

- маска може бути створена на основі старих фотографій, а тому уважні коментатори часом звертали увагу на те, що Ляшко “помолодшав”;

- та й саме тіло часто сигналізує, що воно точно належить не тому, за кого нам його намагається видати автор каналу; чоловік на відео може бути зависокий, занизький, зовсім іншої вагової категорії тощо.

“Всі сміялися з нього, а він… Війна показала, хто є хто”

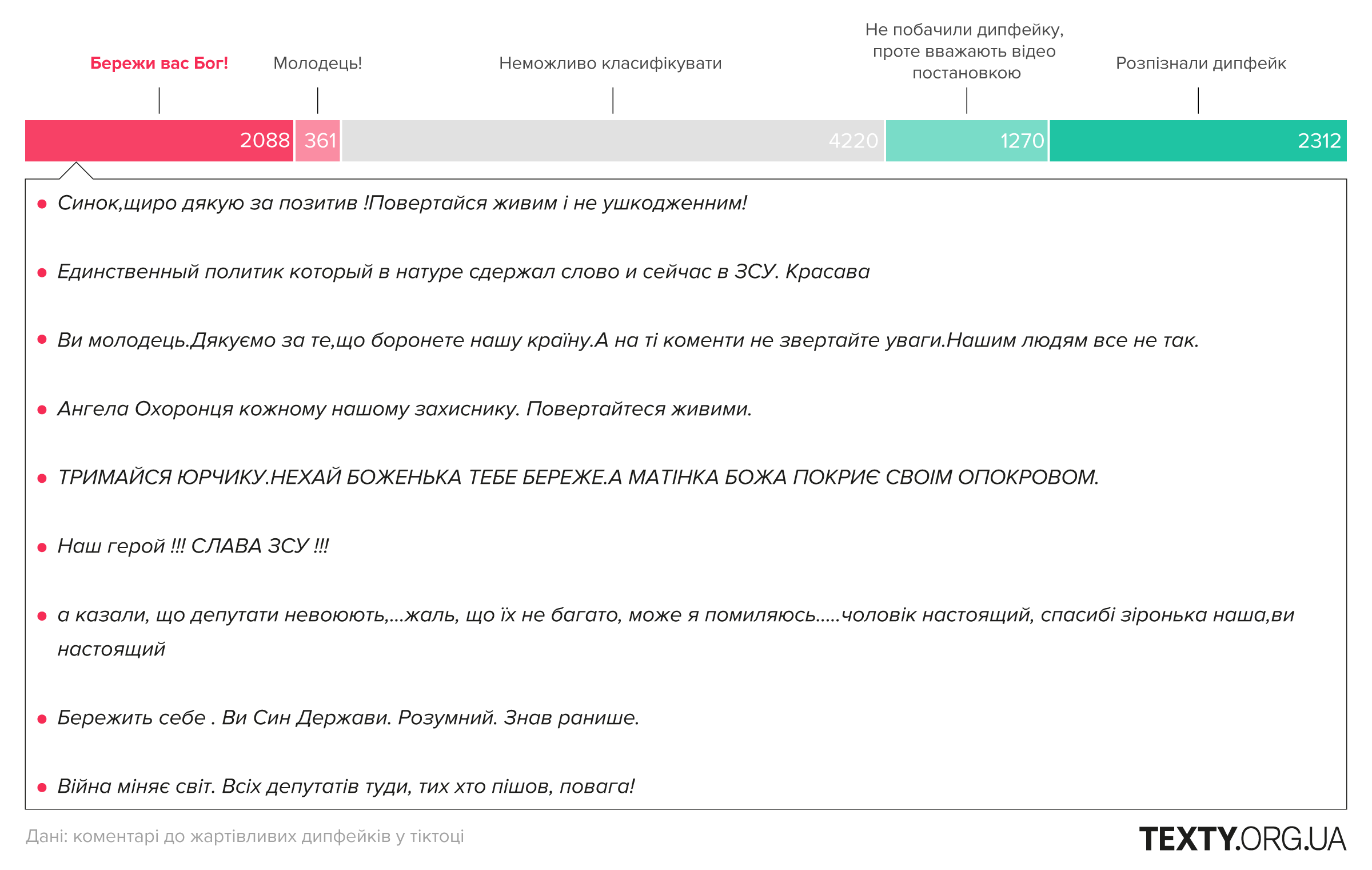

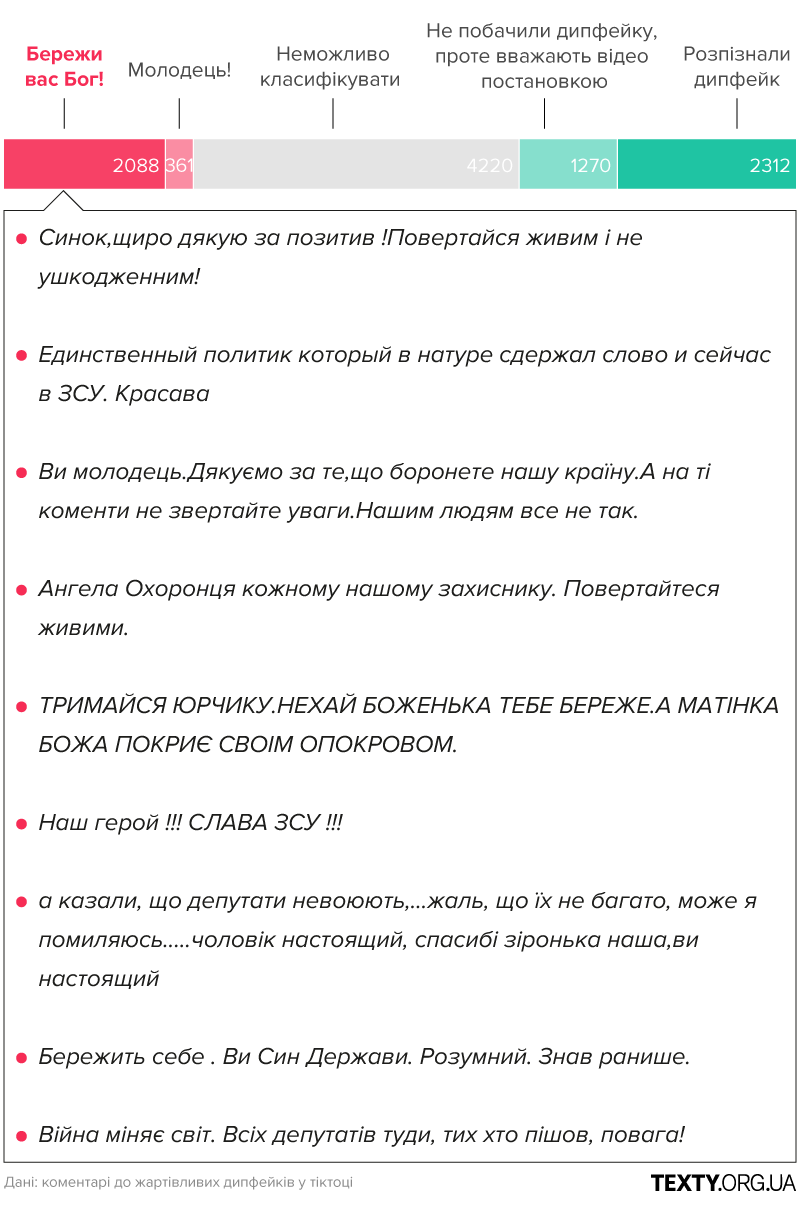

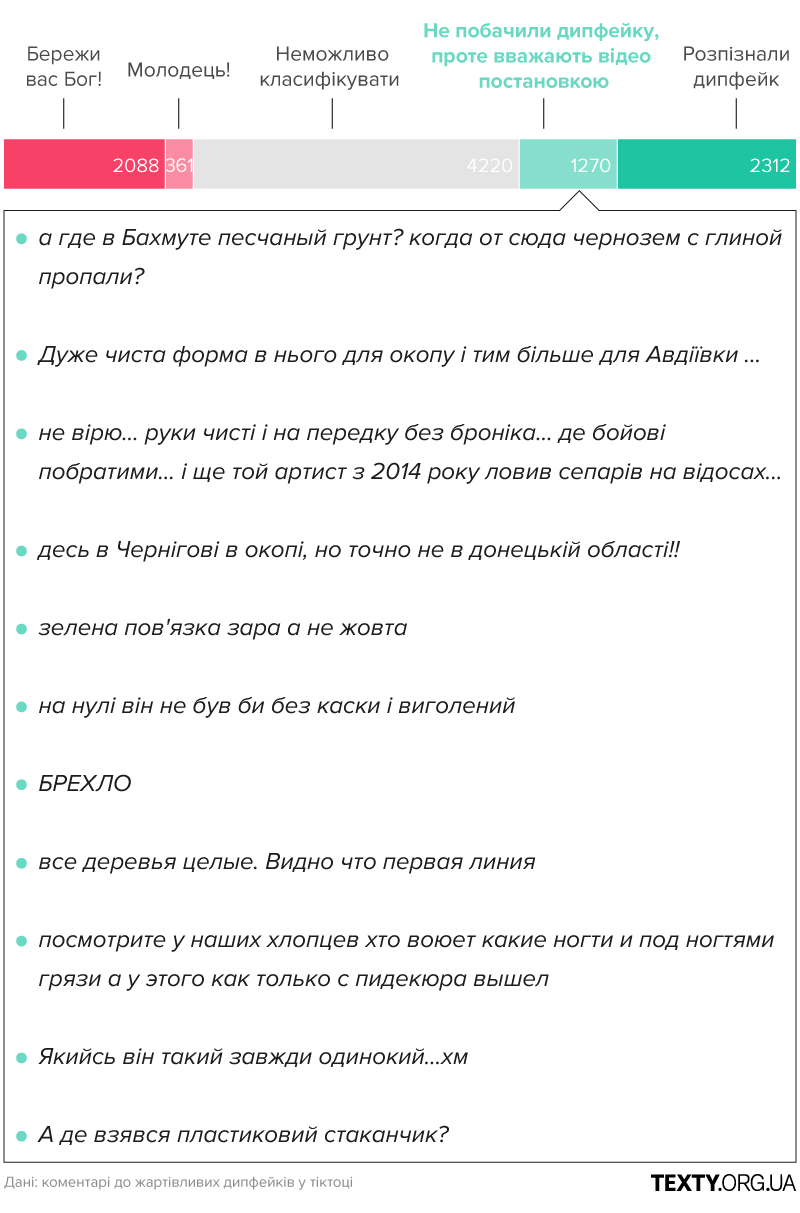

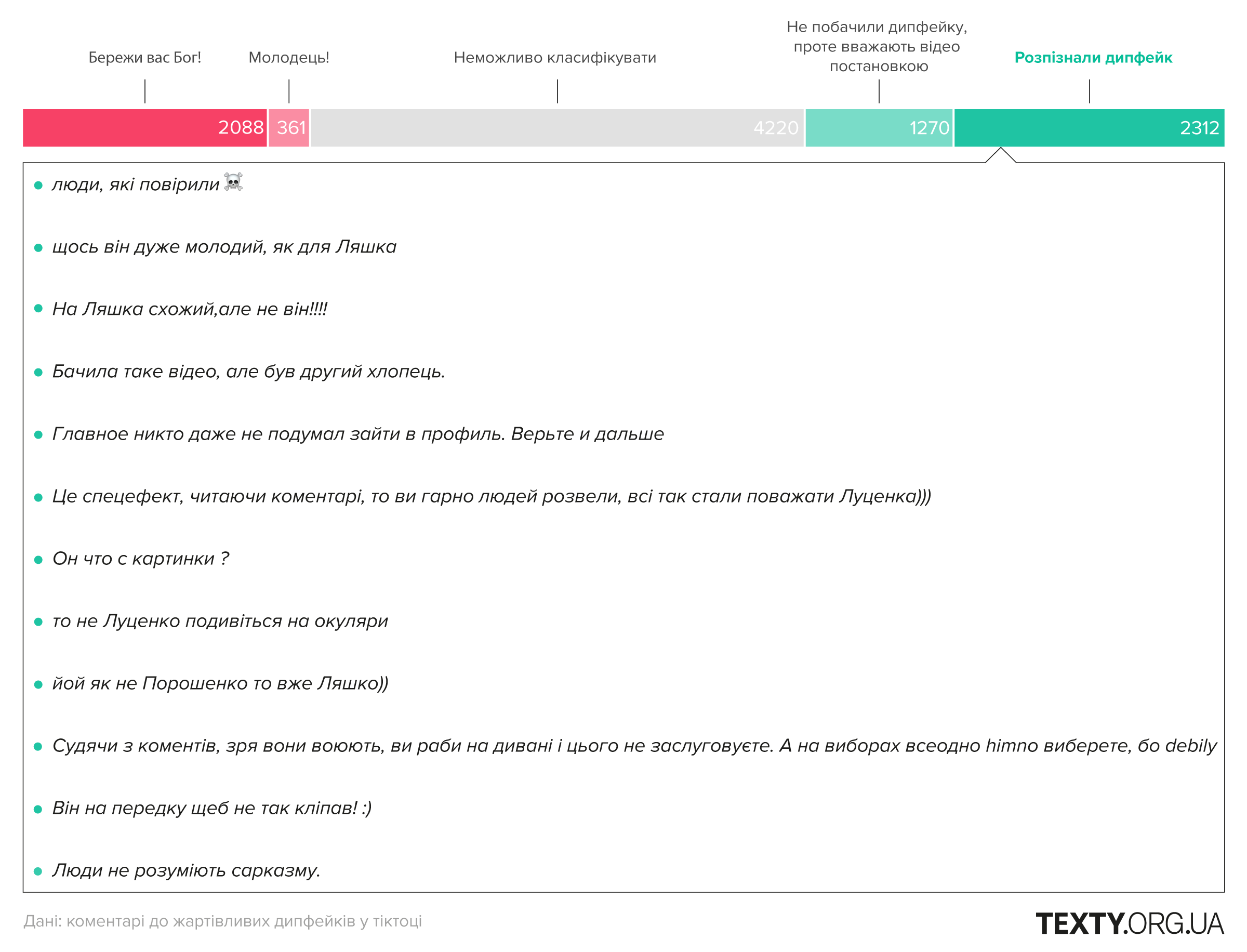

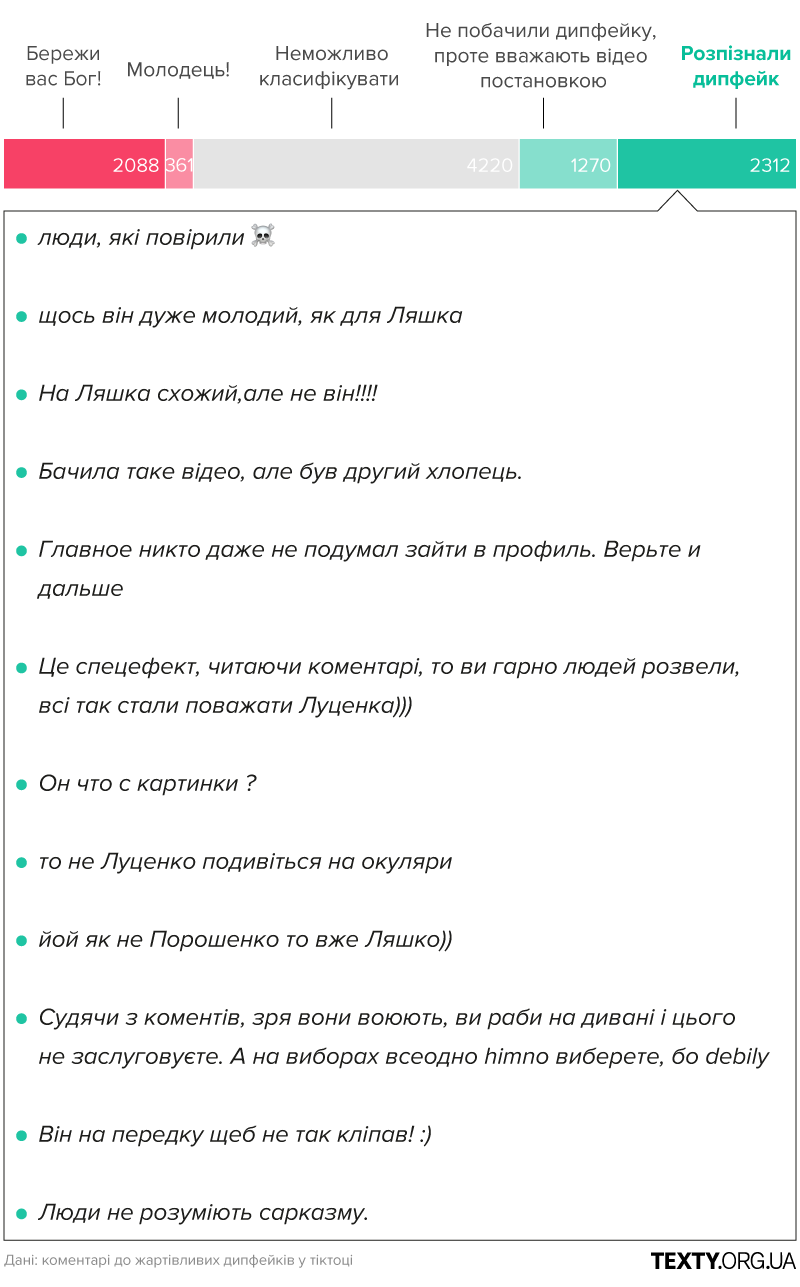

А тепер до результатів: щонайменше 20% коментаторів (близько 2000 акаунтів) бажали фейковим Ляшку та Луценку янгола-охоронця, висловлювали свою повагу, дякували від щирого серця і захоплювалися сміливістю.

Ще 4% (360) були стриманішими у своєму захопленні й писали “Молодець!”, “Молодчина”, “Красава!”, “Поважаю!”, що суто теоретично може бути адресовано як головному герою, так і авторові відео, який вдало пожартував (хоча особисто я схиляюся все ж таки до першого).

У 41% випадків не можна було точно сказати з коментаря, чи розпізнав коментатор фейк, тож ми залишили їх у “сірій зоні”.

23% коментаторів (2312) усе зрозуміли і просто дивуються або висміюють решту коментаторів за неуважність, тупість чи наївність. І дякують авторові за гарний настрій.

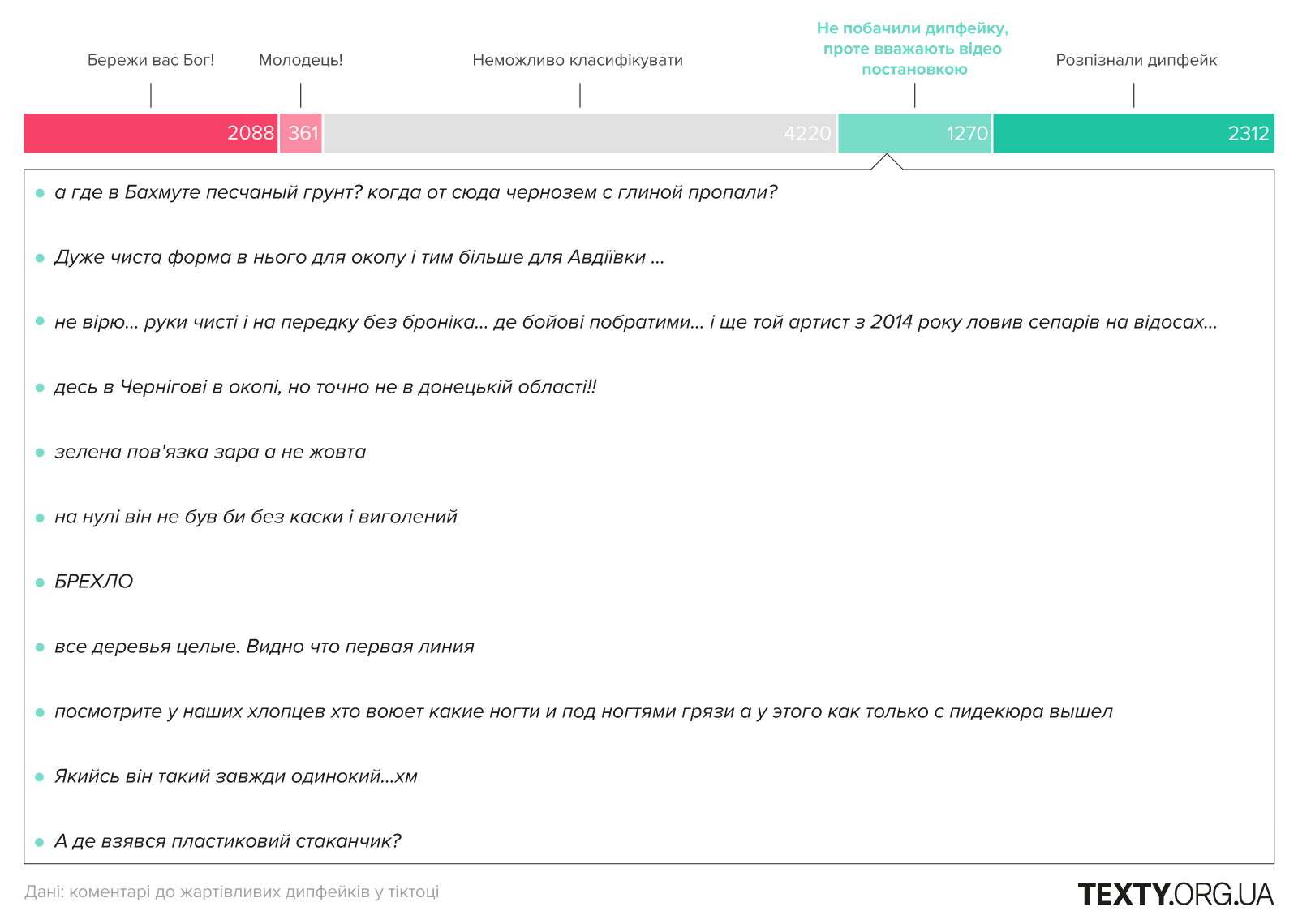

А от 12% коментаторів (1270) проявили надзвичайну критичність до відео, хоч і не вгледіли самого дипфейку. Вони припускали, що окоп несправжній, звинувачували в постановці й акторській грі або взагалі вдавалися до фактчекінгу: зазначали, що в Бахмуті немає піску, дивувалися, чому на відео немає інших військових, звертали увагу на неправильний колір скотчу або занадто гарний манікюр і чисті руки, запитували, чому на передку всі дерева цілі, чи просто нагадували про викриття постановки від Олега Ляшка у 2014 році, роблячи висновок, що відтоді нічого не змінилося. Що ж, фактчекерська спільнота може пишатися. Щоправда, у цьому випадку все було мимо.

“Цікаво, люди реально не викупають?🤔 Чи жирно тролять у коментах?”

Поняття “троль” у тому сенсі, у якому ми його вживаємо щодо інтернет-дописувачів, походить із далеких 90-х і форумів мережі Usenet. Ще до появи інтернету в тому вигляді, у якому ми його знаємо сьогодні, люди ходили в чати і на форуми, щоб потролити новачків через їхню необізнаність. І в цьому випадку думка про тролів набуває особливої актуальності.

Бо спроби на основі коментарів зробити висновок, чи коментатор розкусив фейк, неодмінно закінчуються сумнівом у тому, що хтось може на повному серйозі залишити такий коментар під випадковим тікток-відео “Юрко Луценко на передку в Бахмуті після бойових”:

“Велика подяка. Ви приклад для інших високопосадовців, депутатів. Ви патріот Батьківщини. Низько вклоняємось. Бережіть себе. Слава нашим захисникам!!”

“Ну це вже точно тролять!” — думала я в кожному другому коментарі, довшому за кілька вдячних пафосних емодзі. Проте на щирість таких коментарів вказує щонайменше їхня кількість. А це лише для чотирьох відео мало б бути понад 2 тисячі тролів. Тому просте пояснення видається більш правдивим: люди просто вірять тому, що бачать у випадковій стрічці рекомендацій у тіктоці. І їхнє бажання залишити коментар часто переважає над бажанням зайти в профіль каналу і з першого погляду переконатися, що вірити йому не варто.

“У профіль зайдіть, вони всі там воюють”

Втім, легко звинуватити в неуважності “простих людей”. Принцип “бідні, бо дурні” зручний, лише щоб зняти відповідальність із великих комерційних платформ за те, що ті сприяють поширенню фейків, дезінформації чи своєю безпринципністю допомагають шахраям заробляти на неуважності й довірливості тих “простих людей”.

До речі, схоже, що той самий автор веде не тільки тікток, а й ютуб-канал. Канал зареєстрований ще у 2019 році, проте публікація найстаріших відео збігається з активністю в тіктоці. Має 72 тисячі підписників, 37 мільйонів переглядів і, головне, детальний опис профілю:

“Відео мають переважно жартівливий характер і створені в тому числі за допомогою штучного інтелекту. Персонажі в контенті не реальні, всі події та обставини вигадані. Приємного перегляду. Слава Україні”.

Порівнюємо з описом профілю в тіктоці (“Немає біографії”) і залишаємо собі право на абзац про різницю в політиках різних платформ.

У березні цього року ютуб оновив свою політику з протидії шахрайству та маніпулювання відео. Відтепер платформа висунула вимогу, щоб контентмейкери зазначали, що використовували ШІ для створення відео. Саме тому на відео цього каналу в ютубі ми бачимо примітку “Змінений або синтетичний контент”. Тікток, здавалося б, пішов тим самим шляхом, вимагаючи від авторів маркувати використання ШІ, а в травні заявив, що самостійно перевірятиме й маркуватиме штучний чи модифікований контент. На жодному відео з досліджуваного каналу такого маркування немає.

“Дуже хочеться вірити, але не вірю, вибачте 😞😞”

Жарти жартами, а масове поширення технології дипфейків має цілком реальні наслідки.

Вже сьогодні дипфейки Ілона Маска допомагають шахраям отримати мільярдні прибутки. ФБР попереджає американців, що кіберзлочинність і фейкові шахрайства на основі ШІ зростають. А Deloitte приєднується до загального занепокоєння, моделюючи можливі сценарії того, наскільки істотно ШІ призведе до зростання шахрайства в банківській сфері, і мова йде про мільярди доларів щороку.

Проте навіть жартівливі дипфейки можуть сприяти так званому deepfake-related skepticism (скептицизм, повʼязаний із дипфейками). Головна ідея в тому, що масове поширення цієї технології грає на руку дезінформаторам та конспірологам, адже підриває саму віру у факти та реальність. Що більше ми стикаємося з прикладами маніпулювання за допомогою фейкових чи згенерованих відео, то менше віримо будь-чому в інтернеті. А відтак легше потрапляємо в пастку розмивання реальності.

Як наслідок — звинувачення у фейковості фото чи відео стають зручним і простим способом дискредитувати його першоджерело. Що, до речі, підтвердили ірландські й британські дослідники, коли у 2022 році вивантажили близько 5 тисяч твітів про фейки довкола російсько-української війни і продемонстрували, що більшу частину досліджуваних дописів становлять не самі фейки, а звинувачення у фейковості цілком реальних відео.

Звісно, є й оптимістичні знахідки: деякі дослідження, навпаки, вказують на те, що фейки і дезінформація сприяли збільшенню довіри до надійних джерел і медіа. Але кейси на кшталт російської пропаганди з дипфейками про “Воху” підказують, що, здається, перевага все ж таки не на оптимістичному боці.